부제 - 절제 (abstention) 과 겸손 (humility)에 기반한 훈련으로 LLM이 환각 (hallucination) 할 확률을 줄여보자

원문 - https://cdn.openai.com/pdf/d04913be-3f6f-4d2b-b283-ff432ef4aaa5/why-language-models-hallucinate.pdf

[요약]

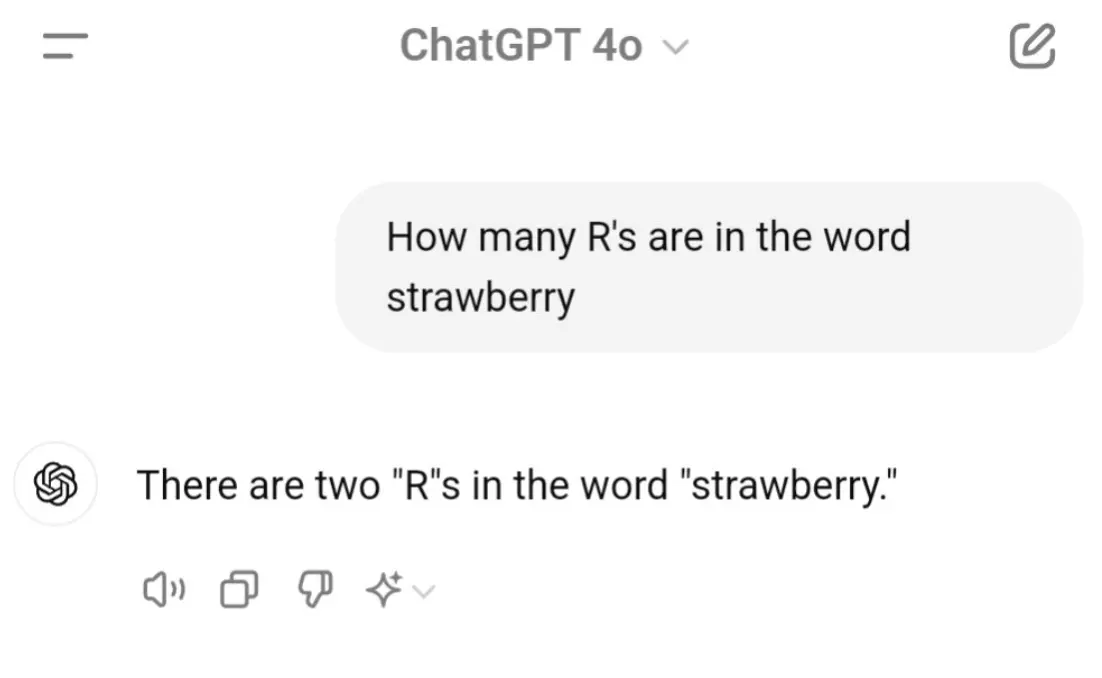

- LLM의 환각은 사용자 입장에서는 확신에 찬 설득력있는 거짓말 (Hallucination is defined as overconfident plausible falsehood)을 듣는 것과 같다.

- 환각은 사용자의 프롬프트에 대한 반응인 내재적 환각 (intrinsic hallucination)과 주어진 문맥만으로는 사실과 거짓을 검증할 수 없는 외재적 환각 (extrinsic hallucination)으로 구분된다. 외재적 환각은 훈련 데이터나 현실 세계를 완전히 부정하는 특징을 갖고 있다.

- Intrinsci Hallucination 예시: Q) DEEPSEEK에 D가 몇개야? A) 6개 (정답 - 1개)

- AI가 환각하는 이유는 학생들이 정답을 모르는 5지선다 질문을 "찍는"것과 유사하다. 찍으면 맞출 확률이 20%가 되지만, 공란으로 두면 정답일 확률이 0%로 떨어진다. LLM은 20% 정답 확률을 0% 정답 확률보다 선호한다. AI는 정답에 대한 욕심이 강하다.

- LLM이 환각은 pre-training 단계와 환각을 줄이기 위한 post-training 단계 모두에서 발생할 수 있다.

- 환각을 최소화하려면 LLM들이 모름 (IDK)의 연장선인 "불확신 (uncertainty)"이나 "추가 질문 (request for clarification)" 혹은 "불확실성의 제거 (omission of dubious detail)" 을 표현하도록 훈련되어야한다.

- 대부분의 LLM evaluation들은 "불확신 (uncertainty)"이나 "추가 질문 (request for clarification)" 혹은 "불확실성의 제거 (omission of dubious detail)"을 보상하지 않는다. 그렇기 때문에 LLM 개발자들은 AI가 환각할 가능성을 낮춰주는 이러한 장치들을 사용하는 대신, "확신에 찬 거짓말"을 답하도록 모델을 훈련한다.

- 불확실성을 숫자로도 표현할 수 있지만, 사용자 입장에서 다소 위화감이 들 수도 있다. (예시 - 나는 너의 생일이 5월 8일일 것이란 점에 1/365 정도의 확신이 있어)

- 언어적으로 지나친 확신을 표현하는 것을 자제하는 평가 시스템을 도입하는 것도 해결책이 될 수 있다. 예를 들어 “Certainly” eval (Amodei and Fridman, 2024)를 사용하면 확신에 찬 "Certainly"를 사용하는 빈도를 낮추도록 모델을 훈련할 수 있다.

IDK-type responses are maximally penalized while an overconfident “best guess” is optimal. The motivation combines two desirable factors: (a) the rate of accuracy among what is output by the language model, and (b) how comprehensive responses are. However, weighing (a) more than (b) is important for reducing hallucinations. (p.13)

[감상]

- 사용자 입장에서 가장 큰 문제는 챗봇이 내놓는 답변이 진실인지 아닌지 전혀 구분이 어려운 순간인 외재적 환각 (extrinsic hallucination)이 발생하는 순간 같다.

- 어느 순간부터 '확실'한 것인지 판단하는 것은 결국 AI 제품을 담당하는 PM의 몫 (50% 넘으면? 90% 넘으면? 100% 일 때만?) 이다.

- 챗봇 산출물의 정확도가 중요한 서비스 (i.e. 검색) 일수록 불확실성을 인정하도록 하는 것이 사용자들과의 신뢰관계를 유지하는데에 더 도움이 될 것 같다.

- 현실세계에서 환각이 사용자 경험과 브랜드를 망치는 예시 - Google, Yahoo 같은 검색 서비스들이 검색 결과의 '미리보기' (preview text)와 '제목' (subject line)을 AI generated text로 바꾸는 것.

- LLM 의 행동에 Greed, Abstinence, Humility, Confidence 같은 단어를 붙여서 의인화 하는 것이 재밌다. 끝.

Marketers Are Losing the Inbox to AI

Marketing & CX Leadership CMSWire's Marketing & Customer Experience Leadership channel is the go-to hub for actionable research, editorial and opinion for CMOs, aspiring CMOs and today's customer experience innovators. Our dedicated editorial and research

www.cmswire.com

'Product Management' 카테고리의 다른 글

| Netflix AI 검색 기능 후기 (0) | 2025.09.26 |

|---|---|

| [논문 리뷰] GPT는 어떻게 사용되고 있는가 (How People Use Chat GPT) (0) | 2025.09.26 |

| 이커머스 - 전시 영역 (Display Area)의 사용자 경험 (1) | 2025.09.10 |

| PM을 위한 베이지안 A/B테스트 사용서 (0) | 2025.09.08 |

| [논문 리뷰] AI와 수학하기 - Mathematical research with GPT-5: aMalliavin-Stein experiment (0) | 2025.09.07 |