인공 신경망 (Neural Network)은 컴퓨터가 인간의 학습 과정을 모사하도록 설계한 알고리즘이다. "고양이는 귀가 세모나고, 털이 길고, 수염이 있어"라고 컴퓨터에게 알려주는 대신에, 고양이 사진 백만장을 보여줌으로써 컴퓨터가 고양이가 무엇인지 직접 학습하도록 한다. 이처럼 인공 신경망은 직접적인 규칙이 아닌 예시를 통해 패턴을 학습한다.

신경망이란?

신경망은 정의된 아키텍쳐 (구조)와 결합했을 때, 결정론적 입력-출력 맵핑을 생성하는 특정한 수치 값 (가중치와 편향)의 구성을 의미한다.

- 아키텍처 - 설계도: 몇 개의 층이 있는지, 어떻게 연결됐는지, 어떤 활성화 함수를 사용하는지 (예시: CNN, RNN, Transformer)

- 파라미터 - 구체적인 숫자들: 실제 가중치 (Weight)와 편향 (Bias) 값

인공 신경망, 왜 중요한가?

Neural Network 기술은 우리 일상에서 이미 중요하게 사용되고 있다.

- Siri, Alexa 같은 Voice Assistant

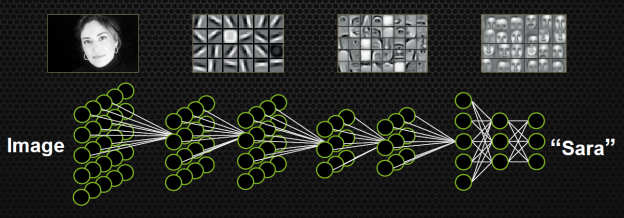

- 사람 얼굴을 알아서 태그하는 사진 앱

- Netflix나 Spotify가 콘텐츠를 추천

인공 신경망 작동 방식

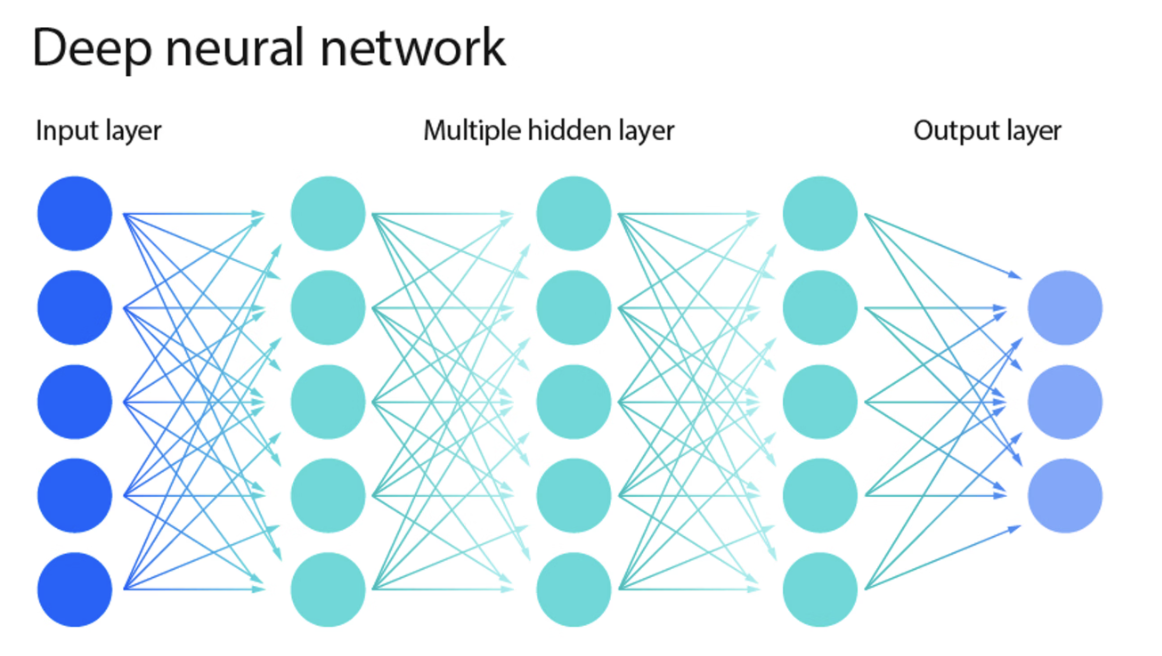

인공 신경망은 세개의 구성 요소 (Input layer, Hidden layer, 그리고 Output layer)로 이루어져 있다.

| Component | Description | Analogy |

| Input Layer | Holds Raw Features (X1, X2,..) | 눈알로 물건을 본다. |

| Hidden Layer | Input을 Feature로 변환한다. | 뇌가 정보를 처리한다. |

| Output Layer | 최종 예측 (prediction)을 내놓는다. | 입으로 '저건 물건이야'라고 말한다. |

스팸 자동 분류기 예시

스펨 이메일이 수신되었을 때 인공신경망은 아래와 같은 순서로 스펨 메일을 구분해낸다.

- Input Stage: 특성들이 추출된다 - "prize", "money" "dear" "win" 같은 단어들

- Early Processing: 첫 레이어의 뉴론들이 각 시그널의 중요도를 판단한다.

- Higher-Level Processing: 이후 레이어들은 정보들을 통합해 상위 레벨 신호로 맥락과 톤을 전달한다

- Decision: 최종 레이어는 이메일이 스펨인지 아닌지 판단한다.

만약 이메일이 스팸일 Threshold인 임계점을 통과하면, 이메일은 스팸으로 분류된다. 네트워크는 "Raw feature"를 의미있는 패턴과 예측으로 학습한 것이다.

원리 - 비선형 함수와 다층 레이어 구조

인공신경망은 인풋 벡터 X = (x1, x2, x3, ...)를 응답값인 Y에 맵핑함으로써 함수 f(X)를 학습한다.

인공 신경망과 전통적인 ML 기법의 차이는 인공 신경망이 (1) 여러개의 층으로 구성되어있다는 것과 (2) 비선형 변환 (non-linear transformation)을 할 수 있는 non-linear activation function (ReLU, Sigmoid, tanh)과 같은 함수를 사용한다는 점이다. 특히 비선형 함수의 사용은 모델이 곡선이나 모양과 같은 비선형적 패턴을 학습할 수 있도록 해준다.

파라미터 (Parameter) - Weights & Biases

학습 과정을 구동하는 파라미터는 가중치와 편향이다. 모델은 훈련 과정에서 해당 값들을 조절하면서 보다 더 정확한 예측을 할 수 있게 된다.

- 가중치 (Weights)는 각 입력 특성이 결정에 얼마나 강하게 영향을 미치는지 조절하는 다이얼 역할을 한다.

- 편향 (Bias)는 결정 임계값을 이동시키는 내장된 값으로, 입력 자체가 약하더라도 뉴런이 활성화될 수 있게 해준다.

뉴런 출력 = 활성화 함수 ( 합 (입력 x 가중치) + 편향 )

Hidden Layer (은닉층) 에서의 계산

은닉층에서는 입력 특성이 해당 가중치와 곱해지고, 이에 편향 향이 더해진다. 그 결과는 곧 다음 층으로 전달되는데, 이 때 선형 변환이 발생한다.

Output Layer (출력층) 에서의 계산

마지막으로, 출력층에서 비선형 활성화 함수 (tanh, sigmoid, ReLU)가 최종 예측을 생성한다. 이 모델 파라미터들이 함께 작용하여 각 뉴런이 전체 계산에 어떻게 기여하는지 결정한다. 학습 과정에서 이 값들을 조정함으로써, 신경망은 점차 정확한 예측을 할 수 있게 된다.

'Machine Learning (인공지능) > 기초' 카테고리의 다른 글

| Score & Calibration (1) | 2026.04.05 |

|---|---|

| [ML] Vectorization (벡터화) (0) | 2025.10.10 |

| [ML] Unsupervised Learning (비지도 학습)의 정의와 종류 (0) | 2025.10.05 |

| [ML] 지도 학습의 데이터셋과 모델 훈련 (Feature, Label, Training) (0) | 2025.10.05 |

| [ML] 지도 학습 (Supervised Learning)의 정의와 종류 (0) | 2025.10.04 |